Processingの画面では、マトリクスLEDの表示シミュレーション(モニタリング)を同時に行うことにします(前回行ったモザイク処理のような方法で赤い円を64個映し出すことにします)。

「Processingの画面(モニタリング)」

Processingのプログラム:

//ビデオライブラリを取り込む

import processing.video.*;

//キャプチャ用オブジェクトを用意

Capture video;

//シリアル通信ライブラリを取り込む

import processing.serial.*;

//シリアル通信オブジェクトを用意

Serial port;

//64個分のピクセル色の配列を用意

int[] pixelValue=new int[64];

//シリアル通信開始用フラグ

boolean start=false;

void setup(){

//画面を160角に設定

size(160,160);

//描画を滑らかにする

smooth();

//映像キャプチャの設定(幅8,高さ8ピクセル,フレームレート30)

video = new Capture(this, 8, 8, 30);

//ポートの設定

port=new Serial(this,"/dev/tty.usbserial-A40014iU",9600);

//外形線なし

noStroke();

}

void draw(){

//背景を黒で塗る

background(0);

//64個分のピクセルの処理

for(int i=0;i<64;i++){

//映像の各ピクセルの色の値を

//明るさの値に変換する

pixelValue[i]=int(brightness(video.pixels[i]));

//円の塗色(赤の値)に代入

fill(pixelValue[i],0,0);

//円を描画

ellipse((i%8)*20+10,(i/8)*20+10,15,15);

//値を送信

if(start){

port.write(pixelValue[i]);

}

}

}

//キャプチャ映像読み込み

void captureEvent(Capture video) {

video.read();

}

クリックでシリアル通信開始

void mousePressed(){

start=true;

}

Processingの方では、VideoライブラリとSerialライブラリの二つを取り込む必要があります。マトリクスLEDが8×8の解像度なので、Webカメラから取り込む映像の解像度も8×8にしておきます(カメラ映像の横縦比は4:3なので、少し縦長の映像になってしまいます)。

*Windowsの場合、そのままの設定ではこのVideoライブラリを使用することができません。WinVDIG 1.0.1をインストールする必要があります。

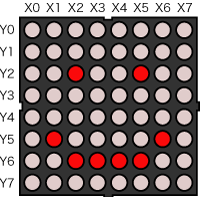

「pixelValue[i]=int(brightness(video.pixels[i]))」では、まず映像の各ピクセルの色をpixels[]で読み込みます。pixels[]は、RGBの三色の値(三つの値)を含んでおり、brightness()で括ると明るさの値(一つの値)に変換されます(0〜255)。変換された値はfloat(小数)なのでint()で括って整数に変換しておきます。この値を、fill()の赤の値に代入し(緑と青は0)、LEDのような赤い円をellipse()を使って64個描画します。8×8を160×160の画面で表示しているので、20×20ピクセルのグリッド状に配置されます。ellipse()の直径はとりあえず15にしておきました。ellipse()のXとY座標は、「%」と「/」を使って計算します(X座標となる「(i%8)*20+10」は、iを8(横幅)で割った余りに20ピクセル掛けて、さらに10ピクセル足すことでellipse()が20×20のグリッドの中心に来るように位置調整しています)。最後に「port.write(pixelValue[i])」で、Arduinoへ各ピクセルの明るさの値を送信します。今回は画面をクリックしたらシリアル通信が開始されるようにしています。

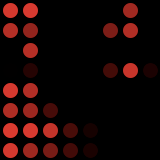

次にArduinoの方に移ります。冒頭で書いたように、今回はマトリクスLEDを、ICを使わず直結します。個々のLEDはダイナミック点灯しているので、点灯時間の長さによって明るさを調整することになります。点灯時間が短ければ暗くなり、長くなれば明るくなります。つまり、Processingから送られて来た明るさの値(0〜255)を、個々のLEDの点灯時間に反映させるプログラムになるということです。マトリクスLEDとの接続方法や詳細については「Arduino マトリクスLED1」を参照してください。

Arduinoのプログラム:

//8x8の二次元配列を用意

byte matrix[8][8];

void setup(){

//出力ピンの設定、すべてオフにする

for(int i=2;i<=17;i++){

pinMode(i,OUTPUT);

digitalWrite(i,LOW);

}

//シリアル通信開始

Serial.begin(9600);

}

void loop(){

//シリアル通信(64個分のデータ)

if(Serial.available()>63){

for(int k=0;k<8;k++){

for(int l=0;l<8;l++){

//読み込んだ値を配列に代入

matrix[k][l]=Serial.read();

}

}

}

//各LEDの点灯制御

for(int i=2;i<=9;i++){

//列の点灯

digitalWrite(i,HIGH);

for(int j=10;j<=17;j++){

//行の点灯

digitalWrite(j,LOW);

//行の点灯継続時間

delayMicroseconds(1+matrix[i-2][j-10]);

//行の消灯

digitalWrite(j,HIGH);

//行の消灯継続時間

delayMicroseconds(256-matrix[i-2][j-10]);

}

//列の消灯

digitalWrite(i,LOW);

}

}

以前の「Arduino マトリクスLED1」とほぼプログラム内容は同じです。異なる部分は、シリアル通信と各LEDを点灯/消灯させる継続時間の部分です。用意する二次元配列は、boolean型ではなくbyte型(0~255の値なので)にしています。

シリアル通信上で干渉しないようにするため、Arduino基盤の0番ピンと1番ピンには何も接続しないことにしています(2〜17番ピンを使用)。シリアル通信では、Processingから送られてくる64個のデータをSerial.available()でカウントして、それぞれの値を予め用意しておいた二次元配列matrixに保存しておきます。送られてくるデータは0〜255(明るさの値)となります。そしてダイナミック点灯していく際に、明るさの値をdelayMicroseconds()に代入して、点灯継続時間と消灯継続時間に割り当てます。delayMicroseconds(0)としてしまうと、0マイクロ秒としては扱ってくれないので、delayMicroseconds()の括弧内に入れられる最小値は1にしてあります。最小1マイクロ秒の点灯時間かつ最大256マイクロ秒の消灯時間のときが最も暗くなるときです。その逆で、最大256マイクロ秒の点灯時間かつ最小1マイクロ秒の消灯時間のときが最も明るくなります。個々のLEDは257マイクロ秒ごとにダイナミック点灯していることになります。個々のLEDの点滅を300マイクロ秒程度にすると点滅しているようには見えないので、今回の257マイクロ秒周期で点滅させれば、ほぼ問題ないでしょう。

関連:

・「シリアル通信1〜5」

・「Arduino マトリクスLED1」

・「Processing Video(Webカメラ)」